Spis treści

- Co dokładnie ogłosiło OpenAI

- Dlaczego governance AI staje się kluczowe

- Architektura bezpieczeństwa ważniejsza niż sam model

- Co governance AI oznacza dla firm

- Jak wykorzystać governance AI w praktyce

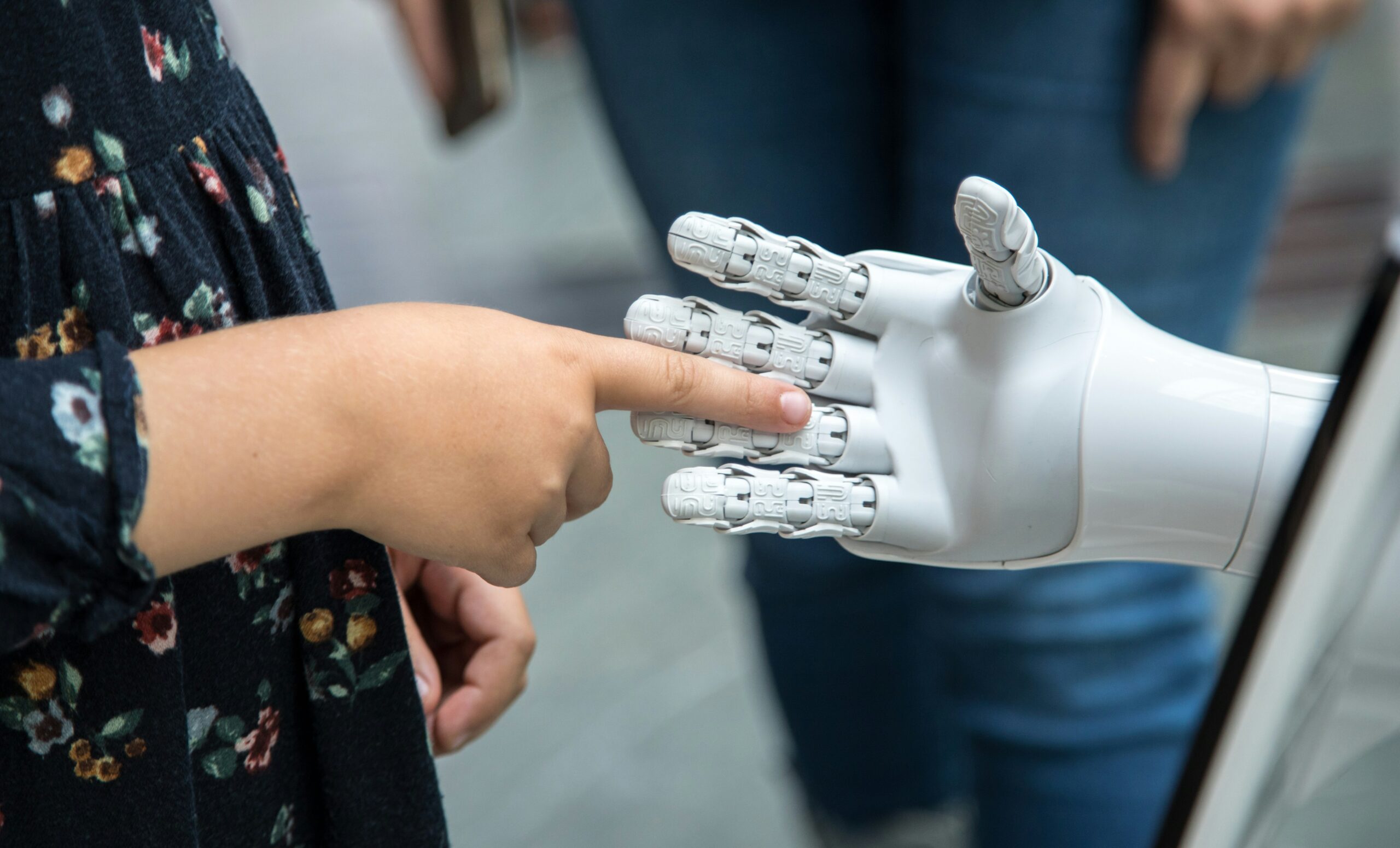

Governance AI coraz wyraźniej przestaje być dodatkiem do projektu i staje się warunkiem wejścia do środowisk wysokiego ryzyka. W nowym komunikacie OpenAI nie akcentuje przede wszystkim samej mocy modelu, ale warunki, na jakich zaawansowane systemy mogą być wdrażane w środowiskach niejawnych i objętych szczególnym nadzorem.

To ważny sygnał dla rynku enterprise. W najbardziej wrażliwych zastosowaniach przewaga nie będzie wynikać wyłącznie z jakości odpowiedzi modelu, lecz z połączenia architektury wdrożenia, zasad kontroli użycia, obecności ludzi w pętli oraz możliwości egzekwowania twardych ograniczeń. Właśnie dlatego governance AI warto dziś traktować jako element architektury, a nie wyłącznie polityki compliance.

Ten materiał warto czytać szerzej niż jako polityczne lub kontraktowe ogłoszenie. To również praktyczna lekcja dla firm wdrażających agentów, bo podobne napięcia między szybkością użycia a kontrolą pojawiają się także przy projektach takich jak pełny stos agentowy czy wdrożenia agentów AI enterprise.

Co dokładnie ogłosiło OpenAI

OpenAI poinformowało o zawarciu porozumienia z amerykańskim Department of War dotyczącego wdrażania zaawansowanych systemów AI w środowiskach klasyfikowanych. Firma podkreśla, że porozumienie ma zawierać więcej zabezpieczeń niż wcześniejsze umowy tego typu i opiera się na kilku wyraźnie zdefiniowanych czerwonych liniach.

W komunikacie pojawiają się trzy główne ograniczenia. Po pierwsze, technologia OpenAI nie ma być używana do masowej krajowej inwigilacji. Po drugie, nie ma służyć do kierowania autonomicznymi systemami uzbrojenia. Po trzecie, nie ma być używana do zautomatyzowanych decyzji wysokiej stawki bez udziału człowieka.

To istotne, bo sam komunikat nie opiera się wyłącznie na deklaracjach etycznych. OpenAI opisuje też konkretne mechanizmy wdrożeniowe: chmurową architekturę deploymentu, zachowanie własnego safety stacku, udział uprawnionego personelu OpenAI w pętli oraz kontraktowe zapisy odnoszące się do sposobu użycia systemu. Źródło omawia to szerzej tutaj: Our agreement with the Department of War.

Dlaczego governance AI staje się kluczowe

Najciekawszy wniosek z tego ogłoszenia nie dotyczy samego sektora obronnego, lecz ogólnego kierunku rynku. Governance AI zaczyna być traktowane jako praktyczny zestaw mechanizmów, które mają ograniczać ryzyko użycia systemu w nieakceptowalny sposób.

W komunikacie widać kilka warstw takiego podejścia. Jedna warstwa to ograniczenia techniczne, czyli utrzymanie safety stacku oraz możliwość niezależnej weryfikacji, czy czerwone linie nie są przekraczane. Druga to architektura wdrożenia, w tym model cloud-only zamiast uruchamiania systemu na urządzeniach brzegowych. Trzecia to warstwa kontraktowa i proceduralna, w której ograniczenia są zapisane formalnie, a nie tylko jako ogólne zasady użycia.

Dla firm to bardzo ważna lekcja. Governance AI nie oznacza już tylko dokumentu polityki albo listy dobrych praktyk. Coraz częściej oznacza projektowanie całego środowiska tak, aby ograniczenia były egzekwowalne technicznie, operacyjnie i organizacyjnie.

Architektura bezpieczeństwa ważniejsza niż sam model

OpenAI mocno akcentuje, że deployment ma być wyłącznie chmurowy i bez wyłączania guardraili. Firma podkreśla też, że nie dostarcza modeli „guardrails off” ani modeli bez treningu bezpieczeństwa. To pokazuje, że w zastosowaniach wysokiego ryzyka governance AI staje się równie ważne jak sam model.

To podejście ma znaczenie także poza sektorem obronnym. W wielu środowiskach enterprise największe ryzyko nie wynika z samej odpowiedzi modelu, ale z tego, gdzie model działa, jakie ma uprawnienia, kto nadzoruje jego użycie i czy firma potrafi wykryć naruszenie założonych granic.

OpenAI wskazuje również na udział ekspertów i inżynierów z odpowiednimi uprawnieniami bezpieczeństwa. To z kolei pokazuje, że governance AI wymaga nie tylko odpowiedniej technologii, ale też ludzi zdolnych stale monitorować system, interpretować ryzyko i poprawiać sposób jego działania w czasie. Ten kierunek dobrze łączy się z tematem workspace agentów w firmach, gdzie kontrola dostępu i akceptacja działań też są krytyczne.

Co governance AI oznacza dla firm

Najważniejszy wniosek jest prosty: im bardziej krytyczny proces, tym mniej wystarczy sam dobry model. Governance AI pomaga odpowiedzieć na pytania o to, czy organizacja potrafi wdrożyć AI w sposób kontrolowany, audytowalny i zgodny z wcześniej ustalonym zakresem użycia.

To dotyczy nie tylko obszarów bezpieczeństwa narodowego. Podobna logika pojawia się w sektorach regulowanych, pracy z danymi wrażliwymi, procesach compliance, cyberbezpieczeństwie, medycynie, finansach czy dużych operacjach back-office. Wszędzie tam governance AI będzie coraz częściej warunkiem skalowania wdrożenia, a nie dodatkiem dorabianym po pilocie.

Dla zespołów wdrożeniowych oznacza to zmianę akcentów. Coraz mniej wystarczy pokazać, że agent lub model potrafi wykonać zadanie. Coraz ważniejsze staje się pokazanie, jak ograniczyć użycie, jak utrzymać kontrolę nad konfiguracją, gdzie jest człowiek w pętli i jak reagować, jeśli system zacznie działać poza zakładanym zakresem.

Jak wykorzystać governance AI w praktyce

Najrozsądniej zacząć od klasyfikacji procesów według ryzyka. Nie każdy workflow potrzebuje takiej samej warstwy kontroli, ale każdy powinien mieć jasno określone granice użycia. W praktyce governance AI daje największą wartość tam, gdzie odpowiedzialność za wynik jest wysoka, a koszt błędu rośnie wraz ze skalą wdrożenia.

- Określ czerwone linie dla procesu. Zanim model trafi do produkcji, trzeba wiedzieć, do czego system nie może zostać użyty niezależnie od presji biznesowej czy wygody zespołu.

- Zaprojektuj architekturę zgodną z ryzykiem. Dla wrażliwych procesów znaczenie mają sposób hostowania, zakres dostępu, logowanie działań, separacja środowisk i możliwość aktualizacji warstwy bezpieczeństwa.

- Nie oddzielaj governance od wdrożenia. Zasady kontroli muszą być częścią projektu technicznego, a nie dokumentem przygotowanym po fakcie.

- Ustal rolę człowieka w pętli. W decyzjach wysokiej stawki trzeba z góry określić, kiedy model tylko wspiera, a kiedy końcową decyzję zawsze podejmuje człowiek.

- Mierz zdolność do egzekwowania ograniczeń. Wysokiej jakości wdrożenie to nie tylko skuteczność modelu, ale także zdolność do wykrywania nadużyć, naruszeń polityki i prób użycia systemu poza zakresem.

FAQ

Czy governance AI jest potrzebne tylko w sektorach wysokiego ryzyka?

Nie. Tam po prostu widać je najwyraźniej. W praktyce governance AI staje się ważne wszędzie tam, gdzie model działa na wrażliwych danych, wpływa na decyzje lub uzyskuje dostęp do krytycznych narzędzi.

Czy wystarczą same usage policies?

Nie. Z tego komunikatu wynika potrzeba podejścia wielowarstwowego: architektury, safety stacku, zapisów kontraktowych i udziału ludzi w pętli.

Co jest tu najważniejszą lekcją dla firm?

Że kontrola użycia modeli musi być projektowana razem z wdrożeniem. Governance AI nie powinno zaczynać się po pilocie, tylko przed pierwszym uruchomieniem w środowisku produkcyjnym.

Podsumowanie

Nowe porozumienie OpenAI pokazuje, że governance AI wchodzi do fazy bardziej operacyjnej i egzekwowalnej. Najważniejszy wniosek nie dotyczy wyłącznie konkretnej instytucji, ale tego, jak będą dojrzewać wdrożenia AI w środowiskach o wysokiej odpowiedzialności.

Dla firm to dobry moment, żeby przestać traktować governance jako warstwę formalną i zacząć budować je jako część architektury produktu, procesu i bezpieczeństwa. To właśnie tam będzie coraz częściej rozstrzygać się, czy AI da się bezpiecznie skalować.

Dyskusja

Dołącz do rozmowy pod wpisem

Komentarze publikujemy po akceptacji. Podaj pseudonim, napisz swoją opinię i zatwierdź politykę prywatności.

Jeszcze nikt nie zabrał głosu. Możesz dodać pierwszy komentarz.